Lensa AI, l’applicazione che genera ritratti artistici grazie all’IA, ha riaperto il dibattito sull’eticità delle applicazioni che addestrano l’intelligenza artificiale usando informazioni personali.

Come funzionano i software basati sull’IA

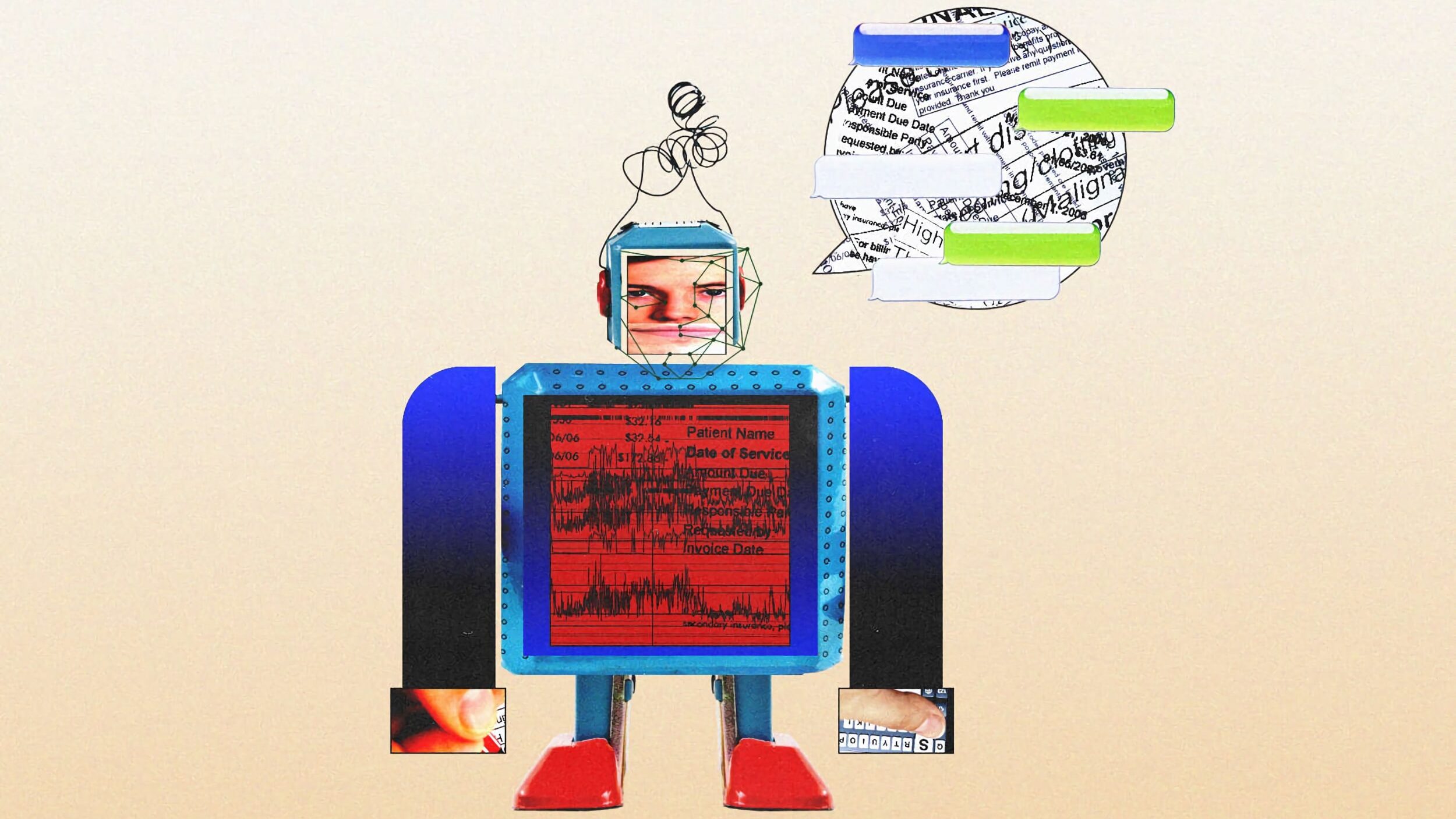

Siamo nell’era dell’intelligenza artificiale e su questo non avevamo dubbi. Nell’ultimo mese (o meglio, nelle ultime settimane in Italia) ha preso piede la moda dei ritratti artistici creati ad-hoc mediante l’applicazione chiamata Lensa AI.

Un’applicazione apparentemente innocua che, grazie a una decina di foto caricate dall’utente, genera quadri fotorealistici e illustrazioni più astratte grazie al lavoro sorprendente dell’intelligenza artificiale (a ottobre vi avevamo anche parlato del concorso artistico vinto dall’IA). Ed è così che i nostri selfie finiscono per addestrare l’IA. Ma siamo sicuri di aver fornito il nostro consenso?

Che piaccia o meno, è davvero questo ciò che accade. Immaginiamoci l’intelligenza artificiale come un enorme divoratore di informazioni che assimila e rielabora costantemente i dati di milioni di utenti; grazie a questi dati, l’IA è poi in grado di generare a sua volta informazioni “nuove” basate su tutto ciò che ha appreso.

Ma non sono solamente i nostri dati personali caricati su Facebook o sul cloud di Apple (che per la prima volta renderà disponibile la crittografia totale dei backup cloud), per citare due piattaforme, a essere raccolti. Le nostre immagini, foto di gruppo o selfie che siano, rientrano a loro volta nelle informazioni sfruttabili e rielaborabili dall’intelligenza artificiale, come quella di Lensa AI.

Se da un lato questo tipo di tecnologia è affascinante, dall’altro causa inesorabilmente varie polemiche legate all’eticità dell’intelligenza artificiale. Come può essere etica una tecnologia che ingurgita le nostre informazioni personali e le rielabora per vari scopi senza nemmeno chiedere il nostro consenso?

Le opere d’arte “originali” di Lensa AI

Nelle ultime settimane abbiamo sentito parlare a lungo di Lensa AI, l’applicazione che genera immagini suggestive grazie all’intelligenza artificiale. Per ottenere il nostro bel dipinto astratto o il nostro ritratto fantascientifico basta dare in pasto all’applicazione dieci immagini, al resto ci pensa la rete neurale Stable Diffusion.

Che bomba, no? Certo, strepitoso, lo dimostra la quantità di immagini di Lensa AI che da settimane popola il nostro feed di Instagram. Tuttavia, le immagini generate dall’applicazione sfruttano modelli creati utilizzando le opere originali di altri artisti.

Beh, penserete che gli artisti in questione siano stati debitamente remunerati e abbiano fornito il loro consenso, no? Ovviamente no. Infatti, molti sono stati gli artisti che hanno accusato Stable Diffusion, il modello di apprendimento di Lensa AI, di aver usato le loro opere senza alcun permesso. Arte originale, frutto di anni lavoro e dedizione, diffusa gratuitamente e istantaneamente tramite un’app scaricata da milioni di utenti.

Il caso di Clearview AI: c’è un nuovo poliziotto in città

Ma quello di Lensa AI non è il primo caso di un’applicazione con IA che finisce per sollevare numerose polemiche. Giusto un paio di mesi fa aveva creato scalpore anche l’applicazione Clearview AI, un software di riconoscimento facciale commercializzato (almeno secondo quanto stabilito dall’azienda) principalmente per le forze dell’ordine.

L’applicazione fornisce infatti un enorme database di foto pubbliche, raccolte scandagliando social media come Facebook, Instagram e LinkedIn. Negli ultimi anni, Clearview AI ha supportato le forze dell’ordine statunitensi nell’identificazione di criminali e sospettati, riconosciuti e scovati mediante una semplice ricerca all’interno del database.

Tuttavia, di recente l’applicazione è stata usata anche al di fuori dell’ambito delle forze speciali. Infatti, il riconoscimento facciale di Clearview AI è stato utile a rintracciare il testimone di un’incidente in Florida e a scagionare un passeggero, che era stato erroneamente accusato di aver causato l’incidente e rischiava fino a 15 anni di reclusione.

Una storia a lieto fine, ma che ha spinto il CEO del software Hoan Ton-That a proporre l’uso di Clearview AI anche ai difensori d’ufficio e agli avvocati degli individui più indigenti. La proposta è stata però accolta con grande scetticismo da molti esperti, che considerano la tecnologia un pericolo contro la trasparenza nei confronti delle persone che verrebbero accusate mediante tale mezzo.

L’IA sfrutta l’assenza di protezione della privacy

La questione etica è quindi sotto gli occhi di tutti. È davvero così innocua l’idea che il nostro profilo Instagram, la nostra bacheca di Pinterest o il nostro nuovissimo album generato con Lensa AI possano un giorno contribuire alla creazione di un robot sicario delle forze dell’ordine o al licenziamento di una persona?

Secondo Emily Tucker, direttrice esecutiva del Centro sulla Privacy e la Tecnologia dell’università Georgetown Law, l’adozione di alcune “buone pratiche” individuali con i propri dati è consigliata ma inutile a livello generale:

Limitare la condivisione di informazioni digitali ogni qualvolta non ci è possibile sapere come verranno riutilizzati i nostri dati è un’ottima pratica individuale, ma questa azione avrà un impatto ridotto sull‘uso improprio dei dati da parte di aziende e amministrazioni.

L’esperta continua affermando che l’unica strategia efficace sarebbe che le persone si organizzassero e richiedessero norme sulla privacy e limitazioni in grado di interrompere l’accaparramento massivo dei dati per scopi a noi sconosciuti.

In questo Paese (Stati Uniti, NdR) la protezione legale in termini di privacy è quasi assente, e le istituzioni più forti sfruttano questa situazione da così tanto che ormai ci comportiamo come se fosse una cosa normale. Non è normale e non è corretta.

I primi passi verso la tutela delle informazioni personali

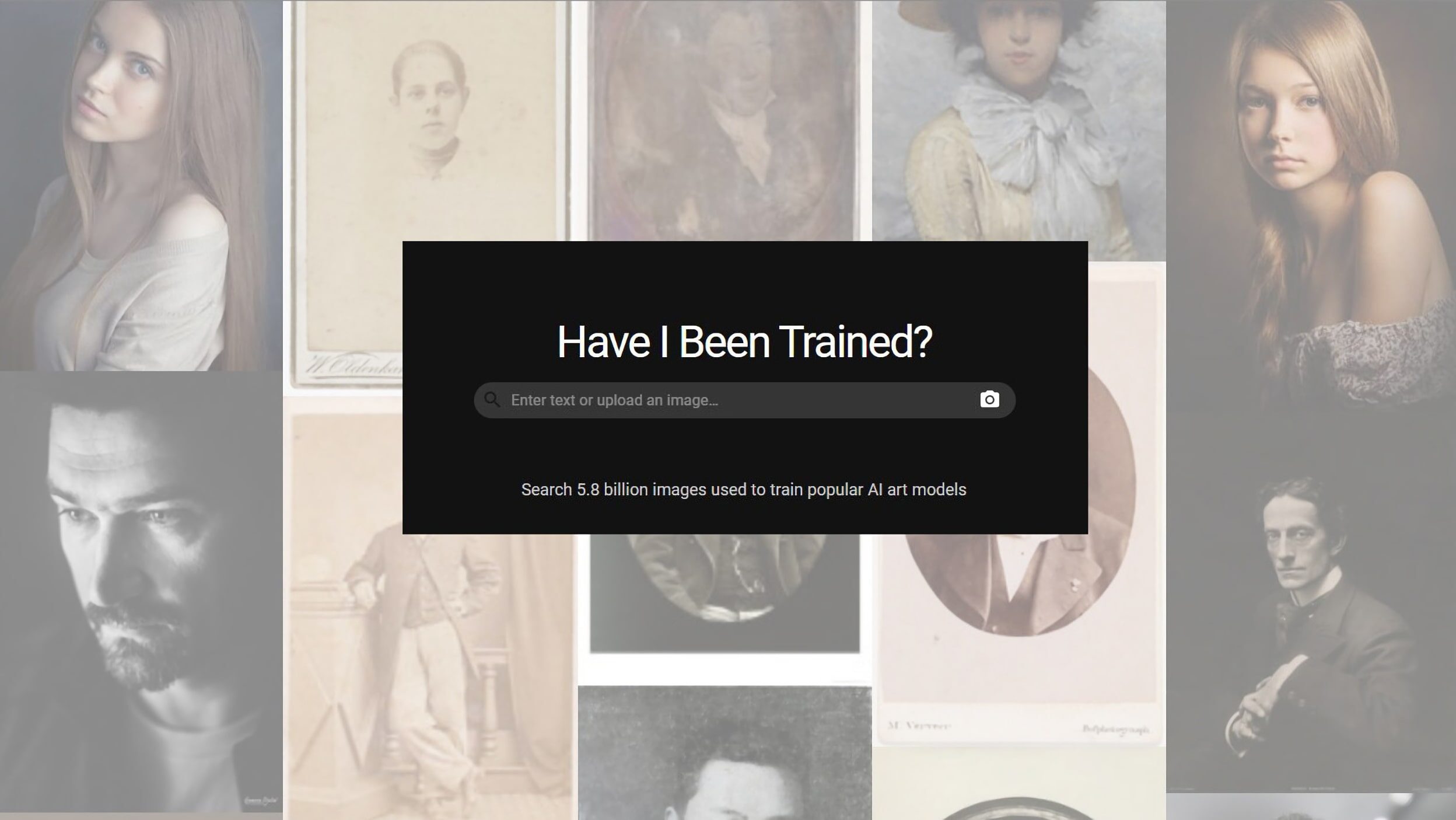

Un primo segnale di risveglio collettivo c’è stato e porta i nomi di Mat Dryhurst and Holly Herndon, due artisti di Berlino che hanno sviluppato un progetto per identificare le opere degli artisti o le foto personali degli utenti all’interno dei database che addestrano i sistemi di IA.

Dryhurst ha inoltre rivelato come alcune delle organizzazioni al lavoro sull’IA, ad esempio la stessa LAION (la raccolta di immagini che genera i ritratti di Lensa AI), incoraggino le persone a segnalare l’immagine personale che desiderano rimuovere dai set di dati. Per questa operazione vi rimandiamo al sito Have I Been Trained.)

Nonostante questi piccoli accenni di svolta, siamo ancora lontani da una situazione ideale; la vera rivoluzione avverrà quando saremo in grado di caricare una foto e di scegliere liberamente se acconsentire o meno al suo uso per addestrare l’IA.

Tuttavia, la grande diffusione dei software di IA ha permesso agli esperti di comprendere meglio gli aspetti positivi e negativi di questa tecnologia; inoltre, ha finalmente esposto il problema etico del consenso personale, che con un maggior impegno potrà un giorno (speriamo) essere risolto.

LEGGI ANCHE: Lensa AI: l’intelligenza artificiale più nota del momento ha dei grossi dubbi da risolvere

FONTI: The Washington Post